Adobe et autres vendent de fausses images de la guerre entre Israël et Gaza générées par IA.

La désinformation commerciale en toute puissance.

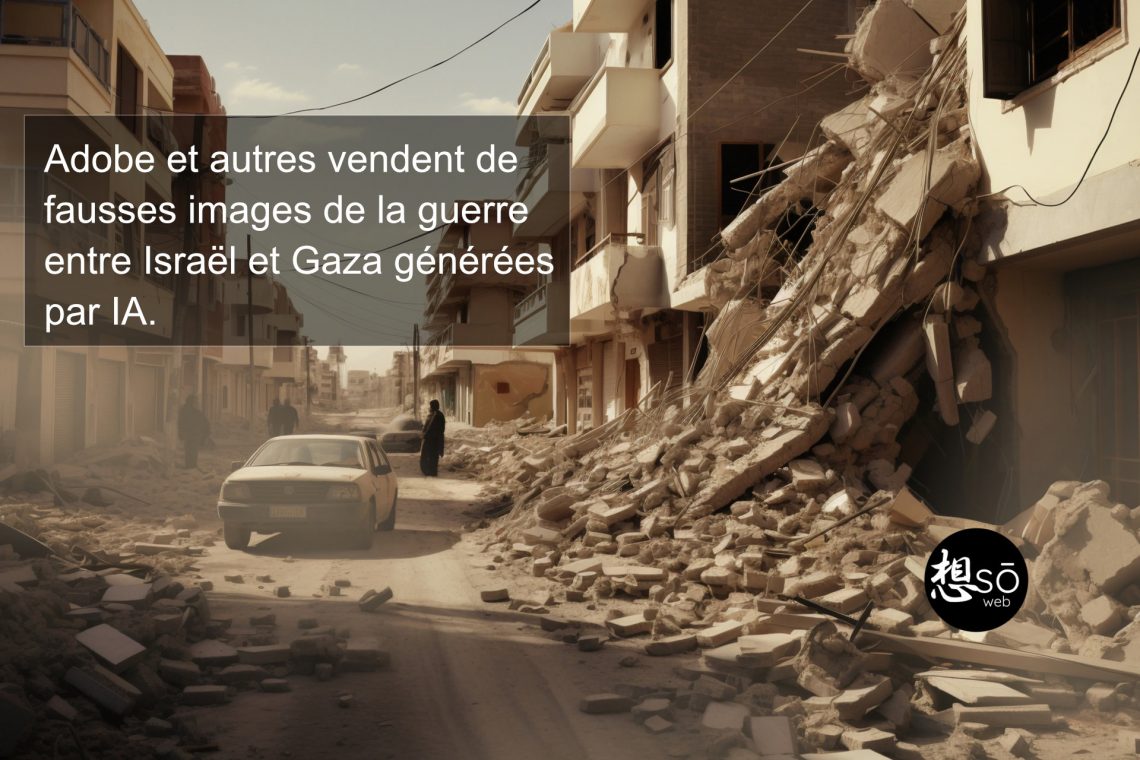

Même la photo de cet article est fausse.

Nos clients le savent, nous sommes abonnés à des sites qui nous permettent de disposer d’images libres de droit. Nous les utilisons pour illustrer des sites web, notre blog ou notre communication sur les réseaux sociaux. Ceci bien entendu afin d’éviter de piquer des images sur le net, ce dont j’ai parlé maintes fois.

Le recherche d’images n’est pas une chose simple. Pour illustrer cet article j’ai recherché dans un site payant et de bonne qualité les termes suivants : « Israël Hamas ». Parmi les premières photos proposées il y a celle que j’ai mis en tête de cet article. Elle pourrait passer pour une photo de guerre mais la légende est tout à fait différente : Street of Marrakech city after earthquake (Rue de Marrakech après le tremblement de terre).

Donc non seulement il faut savoir faire la différence entre des photos réelles aider photos retouchées ou générées par AI. Il faut aussi vérifier l’origine de la photo car souvent et ne correspond absolument pas au thème choisit. Nous avons déjà vu des manipulations d’image dans la presse ou dans les médias depuis des dizaines d’années.

Il faut contrôler l’info même (et surtout) si elle provient d’une entreprise reconnue.

Adobe propose des services d’abonnement permettant aux utilisateurs de télécharger et vendre des images, y compris celles générées par l’IA. Cette intégration de la technologie est réalisée à travers les outils d’intelligence artificielle générative de l’entreprise, tels que Firefly.

Des images très réalistes générées par intelligence artificielle, illustrant le conflit entre Israël et Gaza, sont mises en vente sur le service d’abonnement aux images de stock d’Adobe. Ces images sont utilisées par plusieurs publications en ligne, mais certaines ne précisent pas qu’elles sont le fruit de l’IA, ce qui peut induire en erreur sur la réalité du conflit.

Les contributeurs qui soumettent des images générées par l’IA à la plateforme d’Adobe sont tenus d’indiquer leur nature artificielle. Les images sont également accompagnées de la mention « généré par l’IA » sur le site. Cependant, certaines de ces images semblent tellement réelles qu’elles pourraient être confondues avec des photos authentiques en l’absence de ces indications. Le problème émerge lorsque des publications utilisent ces images pour décrire le conflit entre Israël et le Hamas sans mentionner qu’elles sont générées par l’IA. Ces images, représentant des scènes de guerre saisissantes, risquent de propager des informations erronées, contribuant ainsi à la désinformation déjà présente dans le contexte du conflit.

Non vérifiées, des images déjà utilisées par la presse

Par exemple, une recherche d’image inversée sur une photo de nuages de fumée noire provenant de bâtiments, intitulée « conflit entre Israël et la Palestine, IA générative » par Scheidle-Design, révèle qu’elle a été largement utilisée par différentes publications d’information.

Le souci majeur réside dans le fait que ces publications, délibérément ou non, contribuent à la diffusion d’informations inexactes dans un contexte de conflit où la désinformation et la propagande sont déjà monnaie courante. En pleine confusion entre ce qui est vrai ou faux, cela soulève des préoccupations quant à l’utilisation de l’IA générative à des fins potentiellement manipulatrices.

La désinformation en toute puissance

Ces images, qu’elles le veuillent ou non, peuvent susciter des réactions émotionnelles chez les spectateurs et ont le potentiel de façonner les opinions de ceux qui les voient, en particulier lorsqu’elles sont accompagnées d’articles. La désinformation et l’exploitation de la désinformation sont des préoccupations majeures liées à l’adoption de l’IA. Selon une enquête de Forbes Advisor, 76 % des consommateurs craignent que des outils d’IA tels que Google Bard, ChatGPT et Bing Chat ne génèrent des informations erronées.

0 Comment